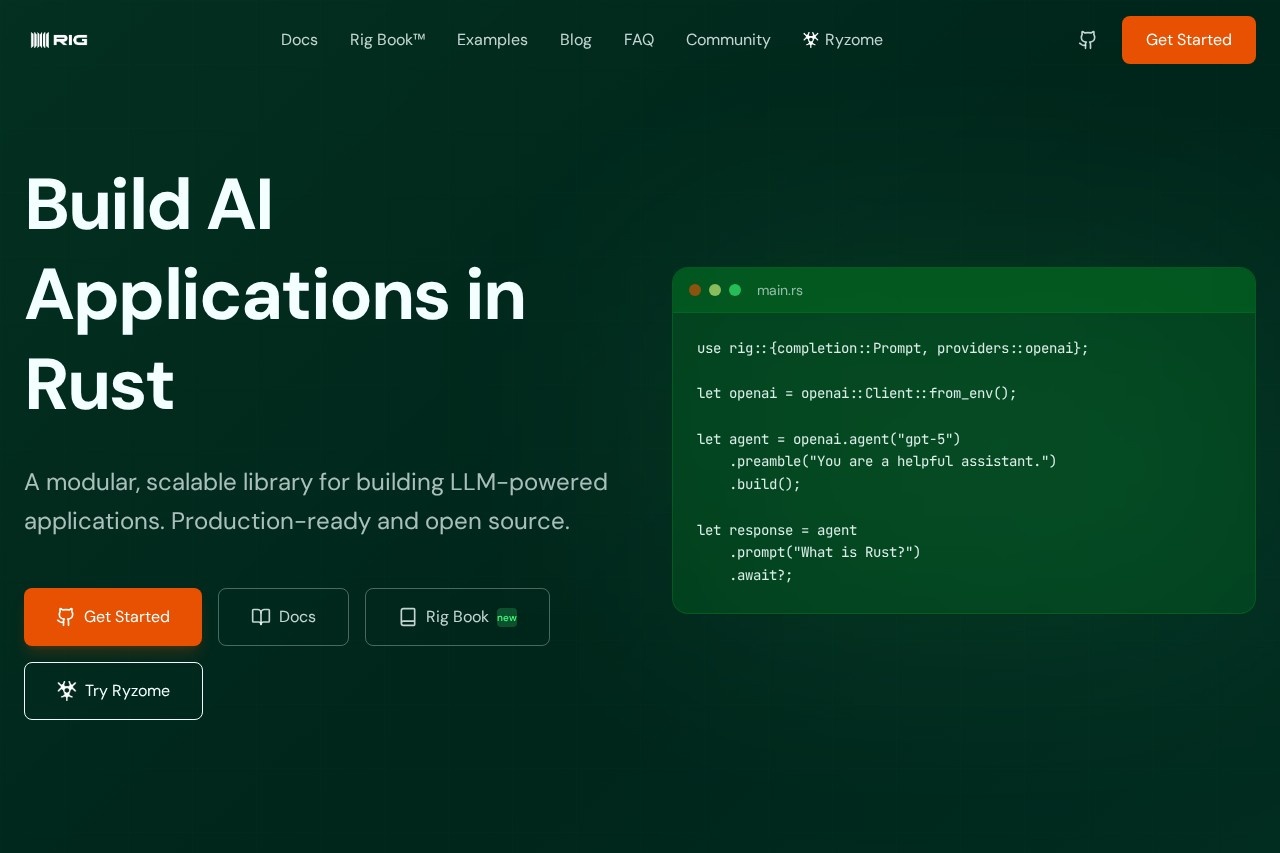

Rig: A Rust framework for building modular, scalable LLM applications. Features a unified LLM interface, Rust-native performance, and advanced AI workflow abstractions to streamline development.

Rig - Build Powerful LLM Applications in Rust

Rig:用 Rust 构建强大的 LLM 应用程序框架

在人工智能应用开发日新月异的今天,开发者需要一个既强大又可靠的工具来构建下一代智能系统。Rig 应运而生,它是一个专为 Rust 语言设计的框架,旨在帮助开发者轻松构建模块化、可扩展的大型语言模型(LLM)应用程序。通过提供统一的 LLM 接口和先进的 AI 工作流抽象,Rig 将 Rust 原生的高性能与人工智能开发的灵活性完美结合,极大地简化了开发流程。

主要功能

Rig 框架提供了一套完整的功能集,以满足现代 LLM 应用开发的核心需求:

- 统一的 LLM 接口:通过标准化的 API 连接和切换不同的底层模型(如 OpenAI, Anthropic,或本地模型),减少供应商锁定。

- 高级工作流抽象:提供链(Chain)、代理(Agent)等模式,方便构建复杂的多步骤推理和任务自动化流程。

- 模块化设计:核心组件如提示词管理、工具调用、记忆模块均可插拔,便于定制和扩展。

- Rust 原生性能与安全:充分利用 Rust 的内存安全、零成本抽象和高并发特性,构建稳定高效的后端服务。

特色优势

选择 Rig,意味着为您的项目注入独特的竞争力:

- 卓越的性能:得益于 Rust 语言,您的应用将具备极高的吞吐量和极低的延迟,特别适合对性能有严苛要求的场景。

- 强大的类型安全:在编译期捕获大量潜在错误,确保复杂 AI 工作流的正确性,减少运行时调试成本。

- 清晰的工程结构:框架鼓励清晰的关注点分离,使得大型 AI 应用代码更易于维护、测试和团队协作。

- 面向生产环境:从设计之初就考虑了部署、监控和可观测性,助力应用平稳上线。

适用人群

Rig 非常适合以下开发者与团队:

- 希望将 AI 功能集成到现有 Rust 后端系统或高性能服务中的工程师。

- 追求极致性能、安全性和可靠性的 LLM 应用构建者。

- 需要构建复杂、可维护且面向生产的 AI 工作流和智能代理的团队。

- 熟悉或愿意学习 Rust,并看好其在 AI 基础设施领域前景的技术爱好者。

常见问题

Q: 我需要很深的 Rust 知识才能使用 Rig 吗?

A: 具备 Rust 中级知识(熟悉异步编程、trait 等)即可开始。框架的清晰抽象有助于您快速上手。

Q: Rig 支持哪些 LLM 提供商?

A: Rig 设计上支持主流的云 API 和本地模型。具体支持列表会随版本更新而扩展,框架的统一接口使得集成新提供商相对简单。

Q: Rig 适合初学者学习 LLM 应用开发吗?

A: 如果您同时希望学习 Rust 和 LLM 应用开发,Rig 是一个很好的实践项目。但若您纯粹想快速原型验证,可能 Python 生态的框架更为直接。

Q: 如何开始使用 Rig?

A: 访问我们的官方文档和 GitHub 仓库,那里提供了详细的入门指南、示例代码和 API 参考。