估值1200亿后Kimi再扔王牌,新架构爆改Transformer老配件,比DeepSeek同款还省钱

分类:AI资讯 浏览量:36

连马斯克、Andrej Karpathy

都纷纷点赞,DeepSeek 和 Kimi 前后脚都盯上的 "残差连接

",到底是什么?

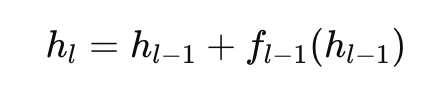

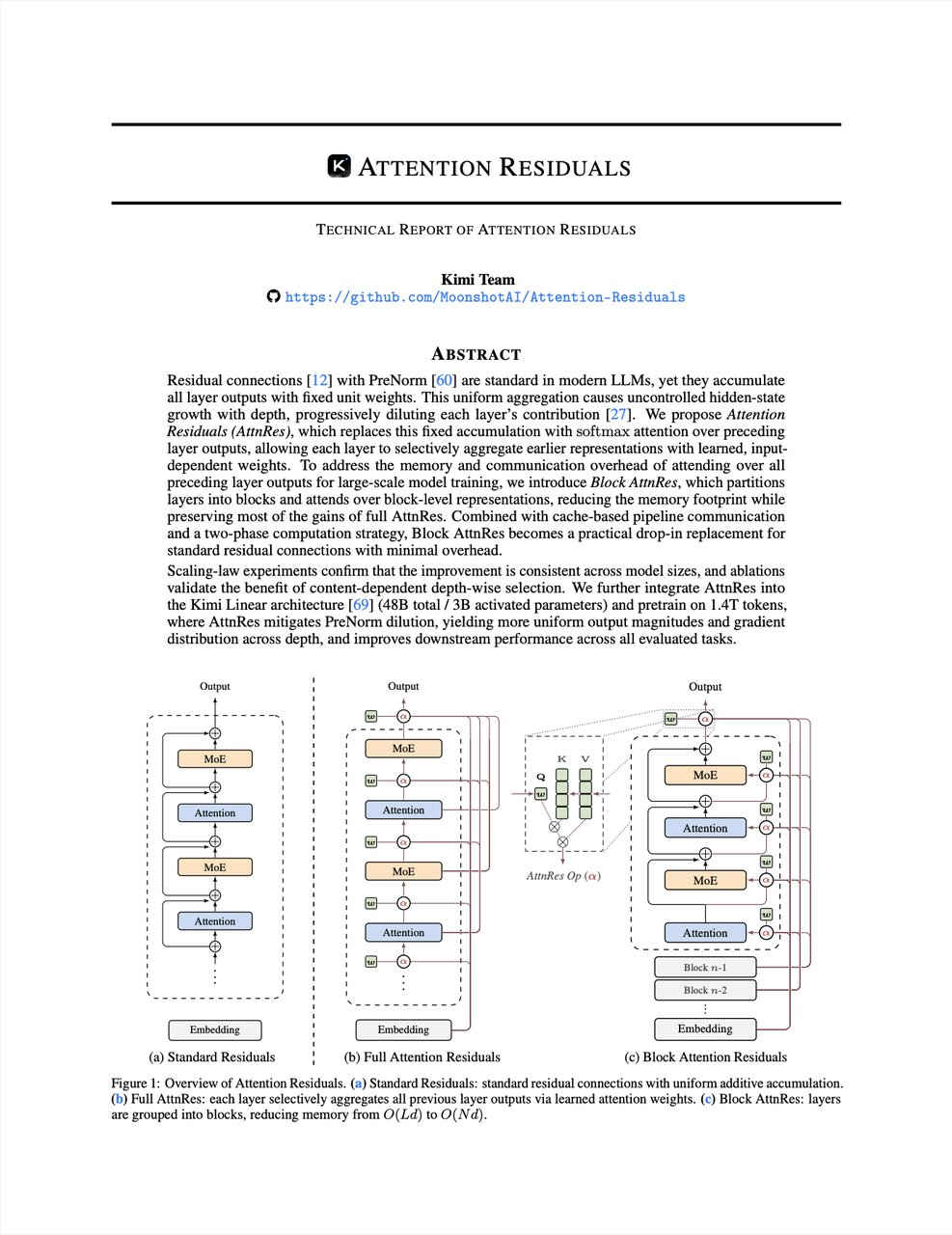

最近,Kimi 放出一篇重磅新论文,瞄准一个过去十年几乎没人动过的 Transformer 底层根基:残差连接

(Residual Connection)。残差连接

由何恺明于 2015 年在 ResNet 论文中提出,此后便成为深度学习领域的标配。

简单来说,可以把大模型的 Transformer 架构,想象成一支几十人排成长队的"传话小组",那么残差连接

就像一条规定:每个工人听完前面所有人的话后,都往里面再补一句,然后原封不动往后传。

但这会带来一个麻烦:队尾的工人收到的话,是前面几十个工人的内容全堆在一起的,越往后话越乱、越长,前面工人说的重点被埋住了,后面工人加的内容也没人听得清,AI 就变笨了。这叫"稀释问题"。

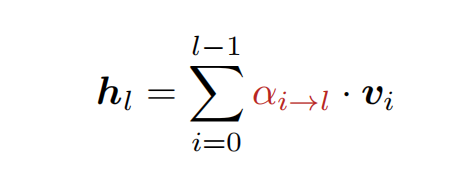

于是,Kimi 想到把 "注意力机制" 引进来解决这一问题,它提出一个新的规则:"注意力残差"(Attention Residuals)。如同给工人们配备了"智能筛选器",不用再全盘收下前面堆出来的大杂烩,可以选择重点听前面自己关心的内容。

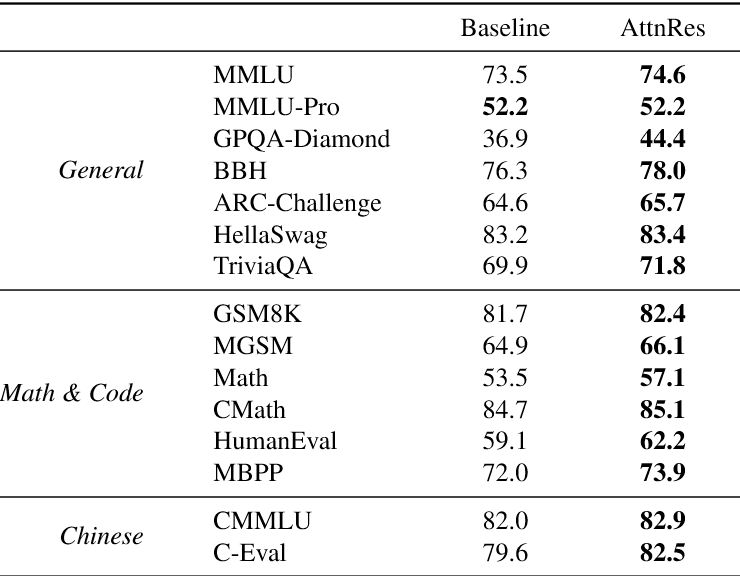

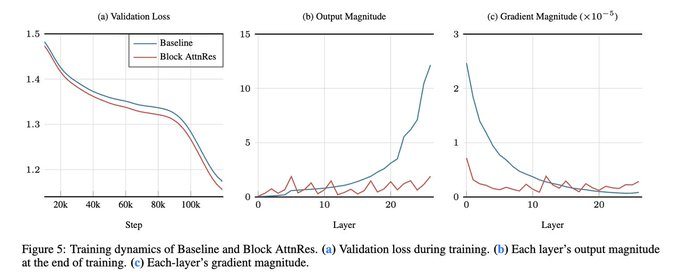

结果,AI 变得更聪明了。不仅实现了全场景的稳定提升,在研究生级专业考试、高等数学推理、代码生成、超长文本理解这类真正考验 AI 硬实力的高难度任务上,更是直接实现了 3-7.5 个点的暴涨

。

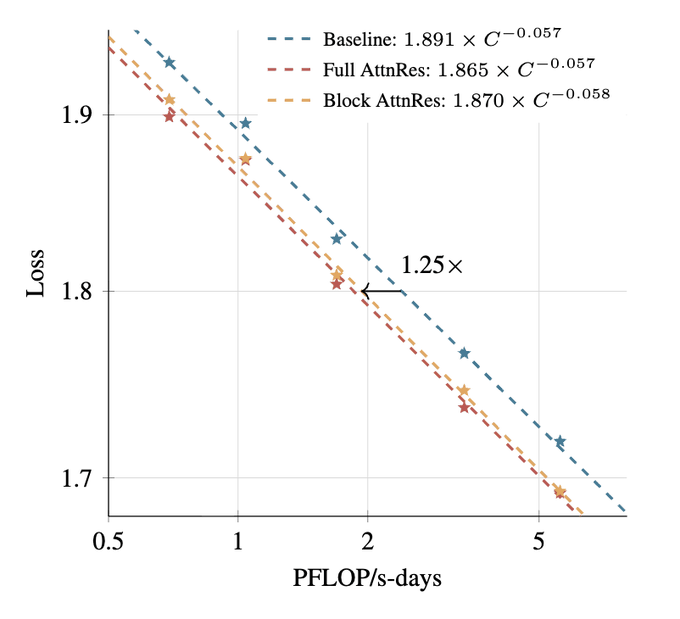

而且更省钱了。在 Kimi 自家的大模型架构上验证显示可以节约 1.25 倍算力

,而训练端到端额外开销不到 4%,推理延迟增加不到 2%,基本没什么额外负担。

而且它完全适配大模型的缩放定律,模型规模越大,这套规则的优势越明显。

Kimi 论文里的精彩关注点

残差连接

之所以能存在这么久,是因为它为 AI 信息的流动开了一条"主干道",把教 AI 的纠错信号一路传下去,从而让深层网络更容易训练,不会把前面的好东西丢掉。

但有三个致命问题改不了:

- 不能挑着听:不管是负责"抓重点"的工人,还是负责"整理内容"的工人,都只能听前面堆成一团的话,不能自己选听谁的

- 丢了的内容找不回来:前面工人说的重点,一旦被后面的内容盖住,就再也挖不出来了,AI 聊着聊着就忘了您最开始说的话

- 内容越堆越多:越往后的工人,必须扯着嗓子喊、加更多内容,才能让队尾听到,不然就被前面的内容盖住了,教 AI 的时候很容易教乱套

之前也有不少人想要改善这些顽疾,比如 PreNorm 这种,只是调整内容整理的顺序,完全不改变残差的固定累加规则,完全没改到根子上;而 Kimi 的灵感来自于他们发现,"序列维度上的时间问题和深度维度上的层问题,本质是同一件事"。

当年 AI 读长句子,只能一个词一个词往后传,前面的内容记不住,后来发明了注意力机制,让 AI 能自己选句子里哪个词重要,一下子就解决了。

DeepSeek 与 Kimi 的解法有什么不同?

虽然都是对残差连接

进行创新,但 DeepSeek 推出的 mHC 却和 Kimi 的 AttnRes 走出了两条路。

DeepSeek 的思路:信息主干道太挤,信息才会乱,那就拓宽多条并行专线,用学习好的规则在专线之间混合、传递。Kimi 的思路:信息主干道不能挑重点才会乱,那就给筛选权。

两者都能提升基础效果,但擅长的领域完全不同:

- mHC:主打"训练稳定性",基础能力有提升,复杂任务乏力。核心价值是能把模型做的更深,训练的时候不会乱套,解决了深层模型训练崩溃的问题。

- AttnRes:兼顾稳定性 + 复杂推理,长上下文、逻辑题提升碾压。它不仅解决了深层模型的训练稳定性问题,更擅长需要精准回溯、多步推理的高难度任务。

在落地适配性上两者天差地别。DeepSeek 的 mHC 更像伤筋动骨的大改造,需要把现有 AI 的单流架构完全改成多流并行架构;而 Kimi 的 AttnRes 是即插即用的替换件,只需要把模型里原来的残差连接

模块换成 Block AttnRes,其他模型结构、训练参数全都不用动。

有网友将 Kimi 的 AttnRes 将与 DeepSeek 的 mHC 进行了性能对比,发现在 Kimi 的消融实验中,Kimi 完整无损版本的 Full AttnRes 性能始终优于 mHC,而 Block AttnRes 的性能与之相当,但 Kimi 的方案需要读写的数据量,只有 DeepSeek mHC 的 1/6。

过去十年,Transformer 的大部分创新都集中在注意力、FFN、MoE、位置编码和训练数据上。残差连接

则像空气一样存在,重要,但过于基础,以至于几乎没人认真去动它。

而现在,DeepSeek 和 Kimi 先后出手,或许正释放一个信号:当数据红利逐渐到顶,下一代大模型或许要开始学会"管信息"来拉开差距。