Claude Opus 4.7 深度解析:编程能力炸裂,视觉升级3倍,AI编程新标杆

分类:AI资讯 浏览量:82

🚀 Claude Opus 4.7 深度解析:编程能力炸裂,视觉升级3倍,AI编程新标杆

2026年4月16日,Anthropic正式发布Claude Opus 4.7,这是目前公开可用的最强编程模型

📊 核心升级一览

Claude Opus 4.7延续了Anthropic每两个月一次的稳定迭代节奏,在编程、视觉、金融分析等多个维度实现显著提升:

| 基准测试 | Opus 4.6 | Opus 4.7 | 提升幅度 |

|---|---|---|---|

| SWE-bench Verified | 80.8% | 87.6% | +6.8% |

| SWE-bench Pro | 53.4% | 64.3% | +10.9% |

| CursorBench | 58% | 70% | +12% |

| Terminal-Bench 2.0 | 58.5% | 69.4% | +10.9% |

| 视觉分辨率 | ~800像素 | 2576像素 | 3倍+ |

💻 编程能力:生产环境任务解决率提升3倍

SWE-bench Pro是AI编程领域最硬核的基准测试,覆盖四种编程语言的完整工程流水线,测试模型在真实生产环境中修复bug、修改代码的能力。

Opus 4.7在该测试中从53.4%跃升至64.3%,单代提升近11个百分点,大幅领先GPT-5.4(57.7%)和Gemini 3.1 Pro(54.2%)。

实际应用反馈:

- Cursor:在93个编程任务benchmark上,任务解决率比Opus 4.6提升13%,包括4个Opus 4.6和Sonnet 4.6都搞不定的任务

- Rakuten:Opus 4.7解决的生产任务数量是Opus 4.6的3倍,代码质量和测试质量评分都有两位数提升

- Intuit、GitHub、Augment Code、Hex等企业反馈coding benchmark提升10-15%

Anthropic称,这是首个能自主通过"隐含需求测试"的Claude模型——模型需自行推断所需工具或行动,而非被明确告知。早期测试中,它甚至能反驳用户,拒绝盲从错误指令,用户评价其"感觉像一个更好的同事"。

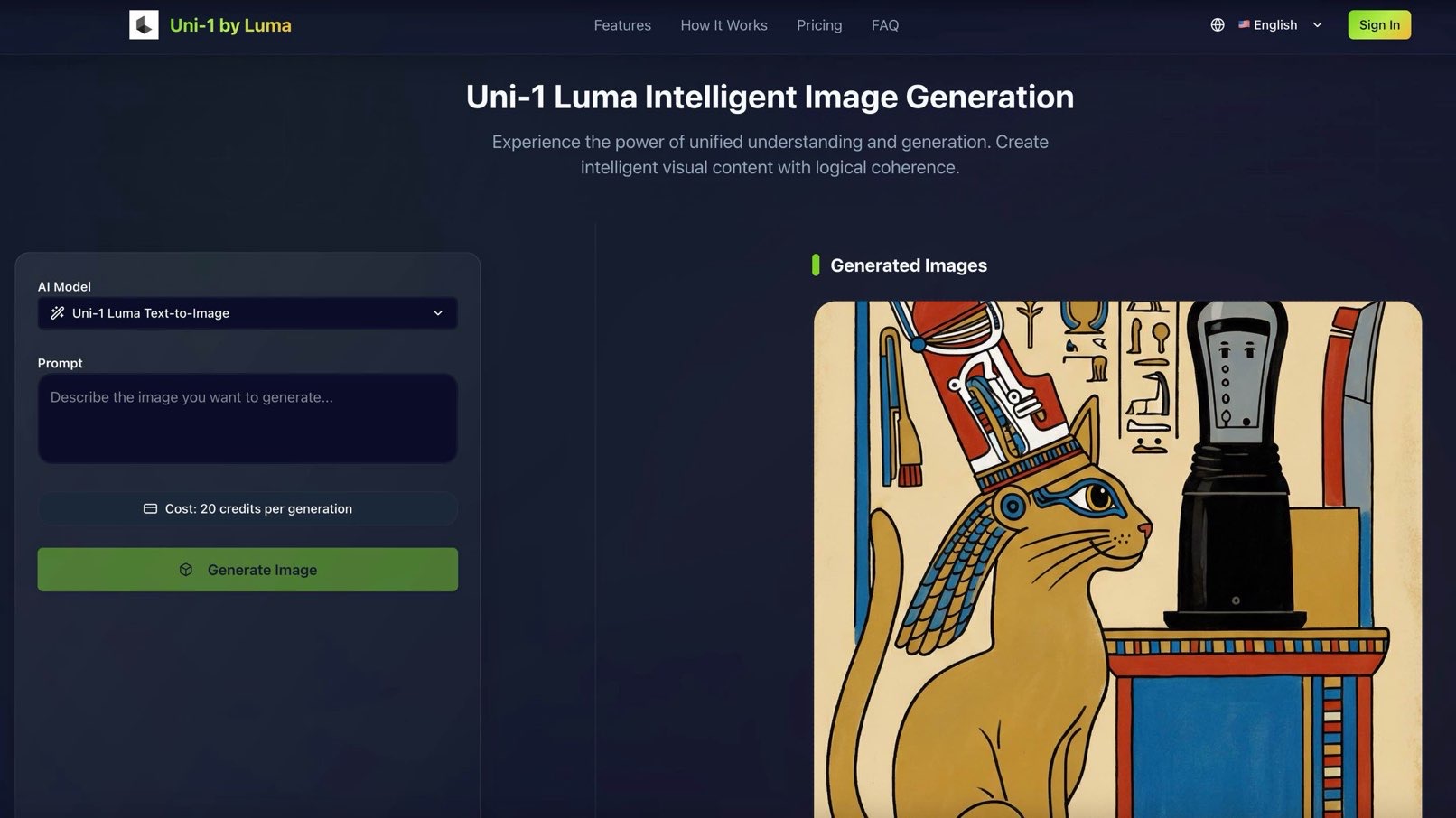

👁️ 视觉能力:分辨率提升3倍,支持2576像素

Opus 4.7的视觉升级幅度相当大。之前的Claude模型能接受的图片分辨率有限,现在Opus 4.7可以接受最长边2,576像素(约3.75百万像素),是之前版本的3倍以上。

应用场景:

- 解读密集截图、复杂图表和界面布局

- 金融分析中的报表识别与数据处理

- 生技业判读化学结构式

- 技术架构图理解与代码生成

官方称其更有"品味"且更具创造力,CharXiv视觉推理基准达到82.1%(无工具)/ 91.0%(有工具)。

🎯 新增"xhigh"努力等级:更精细的推理控制

Opus 4.7引入了全新的xhigh(extra high)努力等级,介于原来的high和max之间。这让开发者可以更精细地控制"推理深度 vs 成本"的平衡。

关键洞察:Hex的CTO反馈,低effort档的Opus 4.7,性能大约等于中effort档的Opus 4.6。也就是说,同样的任务,4.7用更少的token就能达到相同甚至更好的效果。

Adaptive Thinking(自适应推理)机制让模型自己判断每个步骤是否需要深度思考,简单问题快速响应,复杂问题才进入深度推理,资源分配更智能。

🔒 安全升级:Project Glasswing框架落地

Opus 4.7是Project Glasswing框架下第一个正式落地的模型。该框架直面AI在网络安全领域的两面性——风险与机遇。

安全措施:

- 训练阶段针对性削弱高风险网络安全能力

- 内置拦截机制,自动检测并拦截高风险网络安全请求

- 新增Cyber Verification Program,允许合法的安全研究、渗透测试与红队演练

值得注意的是,Opus 4.7并非Anthropic最强模型——Claude Mythos Preview仍因安全顾虑被限制使用,仅开放给Palo Alto Networks、Amazon、Apple等40家机构用于网络安全防御。

💰 定价与成本分析

官方定价不变:

- 输入:$5 / 百万tokens

- 输出:$25 / 百万tokens

- Caching写入:$6.25 / 百万tokens

- Caching读取:$0.50 / 百万tokens

但实际成本需要注意:

- 新tokenizer使同样输入产生约1.0-1.35倍的token数

- Claude Code默认使用xhigh档位

- 对于长任务agent工作流,实际成本可能是Opus 4.6同等设置下的2-3倍

建议:正式切换前用代表性的生产流量跑Opus 4.7,对比token消耗和任务质量再做决定。

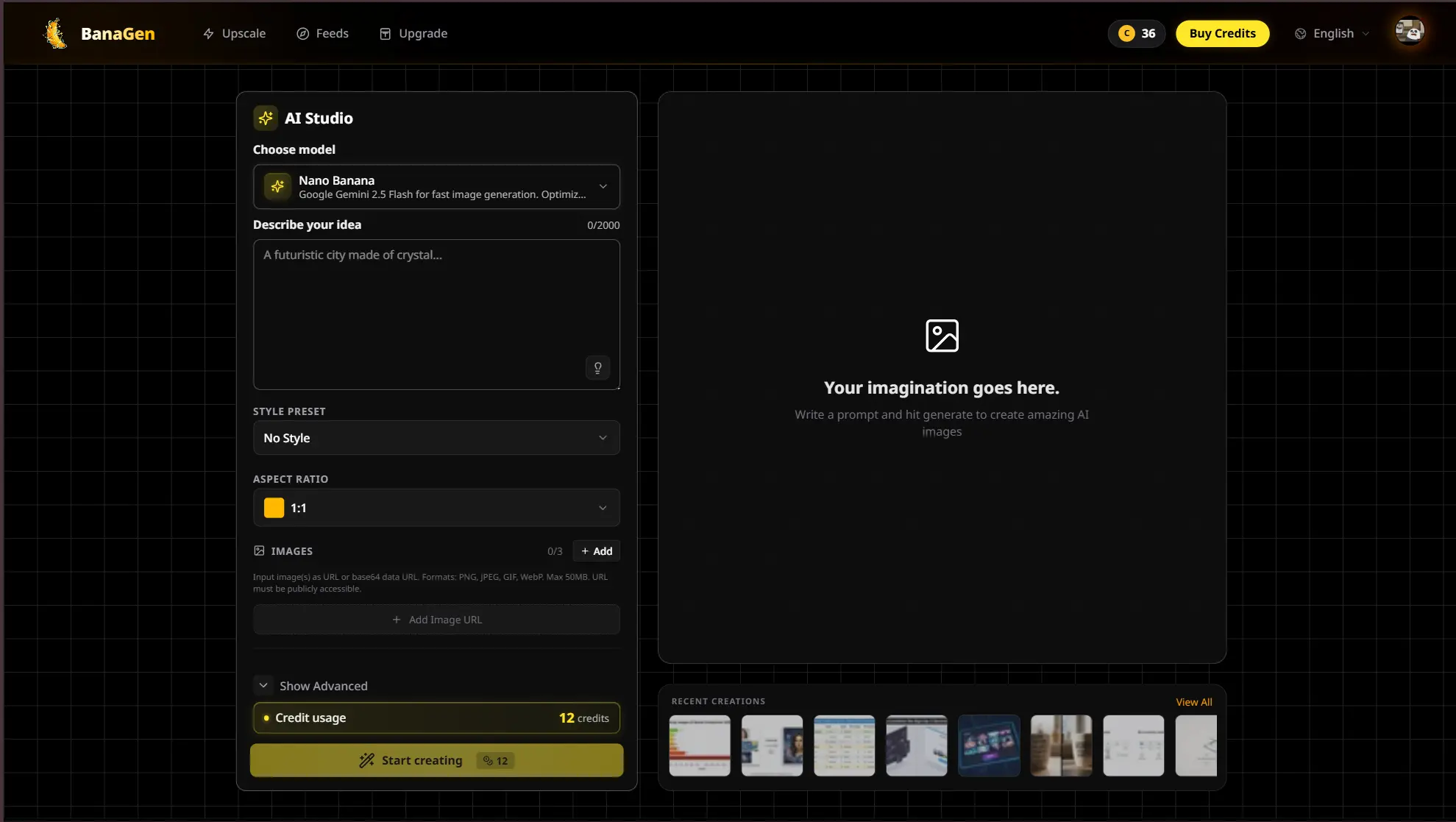

🛠️ Claude Code同步更新

随Opus 4.7一起发布的还有Claude Code的重要更新:

- Auto Mode:AI自动决定哪些命令安全执行、哪些需要人工确认,批量跑任务时不用全程盯着

- /ultrareview命令:启动专门审查会话逐行检查代码,Pro和Max用户每月免费三次

- 自动化Routines:支持定时/API/GitHub触发,合上电脑也能7×24小时运行

- Task Budgets:帮助开发者在长时间操作中合理分配token预算

Claude Code年化营收已达25亿美元,是AI编程工具领域有史以来增长最快的产品。

📈 与其他顶级模型对比

| 模型 | SWE-bench Verified | SWE-bench Pro | MCP-Atlas | BrowseComp |

|---|---|---|---|---|

| Claude Opus 4.7 | 87.6% | 64.3% | 77.3% | 79.3% |

| GPT-5.4 | 82.3% | 57.7% | 68.1% | 89.3% |

| Gemini 3.1 Pro | 80.6% | 54.2% | 73.9% | 85.9% |

| Claude Opus 4.6 | 80.8% | 53.4% | 72.5% | 83.7% |

整体而言,在直接可比基准上Opus 4.7以7比4的优势领先GPT-5.4,各实验室差距正在迅速缩小。

⚠️ 注意事项

1. 指令遵循更字面化

Opus 4.7对指令的解读更字面化,旧模型对指令是"松散理解"甚至跳过某些部分,现在Opus 4.7是字面意思照单全收。API用户升级前最好重新审视prompt。

2. 长上下文能力有取舍

长上下文基准MRCR v2 @1M从Opus 4.6的78.3%跌到32.2%,这是Anthropic的"精准刀法"——牺牲部分长上下文能力换取编程和视觉能力的提升。

3. API兼容性

旧的thinking写法不再兼容,非默认temperature/top_p/top_k会直接返回400。

🎯 总结

Claude Opus 4.7的核心逻辑不是比谁更会写诗、谁更能编故事,而是让AI在执行长链路、高难度的工程任务时变得足够"靠谱"。

适合升级的场景:

- 复杂软件工程任务

- 需要高分辨率视觉理解的工作流

- 金融分析、法律文档处理

- 多步骤agent自动化

值得等待的场景:

- 超长上下文处理(1M token以上)

- 预算敏感的生产环境

- BrowseComp类深度网络检索任务

榜单上的数字已经给出了答案——在编程这个最硬核的赛道上,Opus 4.7是目前公开可用的最强模型。不妨升级体验一下,看看它能不能帮你把那些最头疼的代码活,真正交给AI来扛。

来源:Anthropic官方公告、腾讯云开发者社区、36氪、Vellum AI等